تاثیر deep learning در لبخوانی

لبخوانی کار دشواری است و نتایج آن متفاوت است اما بطور میانگین اکثر افراد هنگام لبخوانی کردن از هر 10 کلمه تنها یکی را تشخیص میدهند و البته دقت افراد متخصص در این زمینه نیز متفاوت است. مطمئنا هیچ دانشمندی در زمینه لبخوانی وجود ندارد، با این حال بعضی از محققان عنوان کردهاند که تکنیک های تکنولوژی “Al” در زمینه یادگیری عمیق(deep learning) میتواند این ناتوانیها را بهبود ببخشد. جدا از اینها، متدهای Al(هوش مصنوعی) که بر روی خرد کردن حجم عظیمی از دادهها به منظور یافتن الگوهای مشترک تمرکز میکند توانسته تکنولوژی تشخیص صدا را تا حد و اندازه سطح بشر ارتقاء دهد. پس چرا این تکنولوژی برای ارتقاء لبخوانی جوابگو نباشد؟

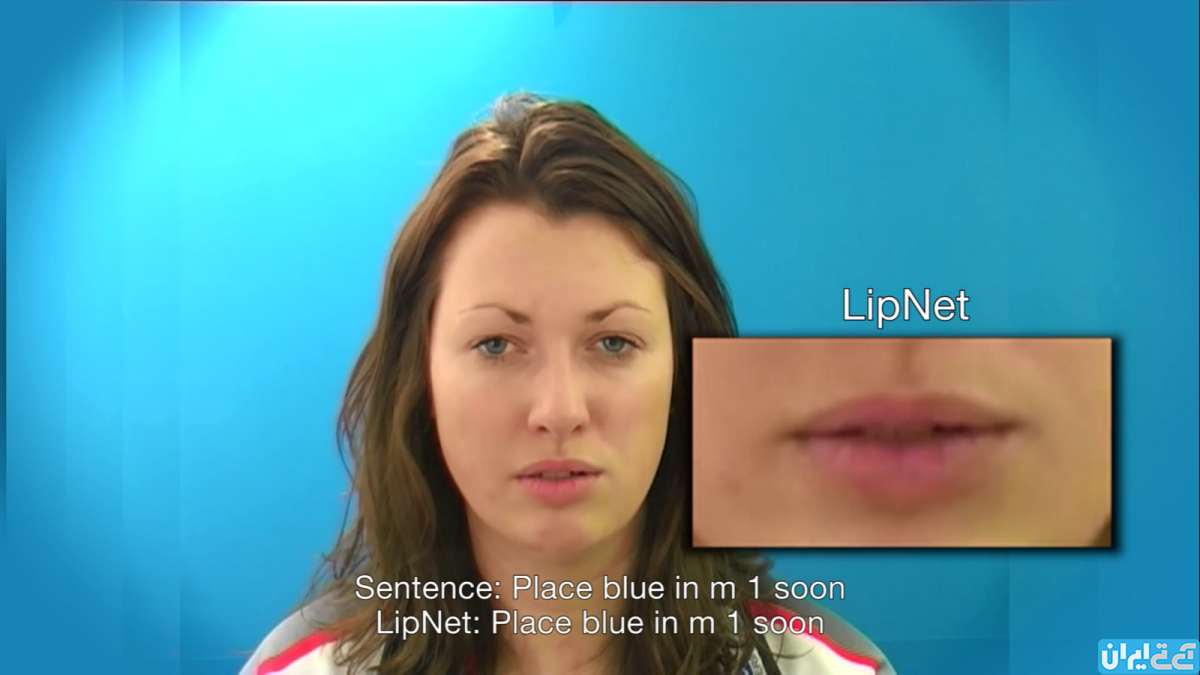

محققان بخش آزمایشگاهی تکنولوژی “Al” در دانشگاه آکسفورد، همکاریهای امیدوارکنندهای در این زمینه داشتهاند و موفق به راهاندازی برنامه لبخوانی جدیدی از طریق یادگیری عمیق شدهاند. این نرمافزار ملقب به “LipNet” قادر است لبخوانی را در سطحی بسیار بالاتر از افراد مجرب در این زمینه انجام دهد. دقت این نرم افزار در تستهای انجام شده 93.4% بوده در حالی که دقت انسانها به طور میانگین 52.3% ثبت شده است. با اینکه نرمافزار در مراحل ابتدایی خود به سر میبرد، اما بینهایت سریع بوده و قادر است ویدیوهای بیصدا را به سرعت همان فیلم به متن تبدیل کند.

اما این تحقیق و نرمافزار دانشگاه آکسفورد شامل محدودیتهایی هم میشود. برای شروع، نرم افزار بر روی یک سری اطلاعات تحقیقی به نام “GRID” تست و اجرا شد. این دسته اطلاعات شامل دهها هزار ویدیو کلیپ کوتاه از 34 داوطلب در حال خواندن جملات بی معنی میشد. هر کلیپ تنها سه ثانیه طول میکشید و هرجمله از الگوهای خاصی پیروی میکرد: دستورات، رنگها، حروف الفبا، حروف اضافه، اعداد و قیدها. حتی کلمات درون این الگوها نیز محدود هستند. به طور کلی تنها چهار دستور و رنگ استفاده شدهاست.این تکنولوژی جدید منجر به این شد که دو تن از محققان اظهار کنند که یافتههای این تحقیق بیش از حد آشکار کننده هستند، مخصوصا بعد از توییت جنجالی و احساس برانگیز یک محقق در رابطه با این پروژه که اظهار داشت با وجود این تکنولوژی دیگر “هیچ رازی” باقی نخواهد ماند.

اما مطمئنا قضیه این نیست. پس از مصاحبه با دو تن از محققان (یانیس آسائل و برندان شیلینگفورد) مشغول در این پروژه هر دوی آنها اعتراف کردند که دایره لغات و دستور زبان استفاده شده در تحقیق آنها محدود بوده و این به دلیل محدودیت در دادههای موجود برای انجام پروژه بوده است. این دو محقق در ادامه گفتند: “دسته اطلاعات در اختیار ما بسیار کوچک بود اما نتایج حاکی از این است که در صورت وجود دادههای بزرگتر، قدرت اجرای این نرم افزار نیز بیشتر از قبل خواهد شد”.

هردو محقق اصرار داشتند که اعلام کنند این تکنولوژی هیچ کاربردی در زمینه نظارت نخواهد داشت، چون به منظور لبخوانی اشخاص شما نیاز دارید که زبان شخص را مشاهده کنید، و بدین معنی است که برای گرفتن نتیجه دلخواه(لبخوانی)، دوربین باید دقیق و در زاویه کاملا مناسب قرار بگیرد. از لحاظ فنی، استفاده ازهرنوع نرمافزار لبخوانی برای نظارت تقریبا غیر ممکن یا در بهترین حالت فوقالعاده دشوار است. همچنین باید اضافه کرد که نرخ فریم دوربین نیز یکی از فاکتورهای اصلی برای استفاده از این نرمافزارها است که این نرخ فریم در دوربینهای نظارتی بسیار پایین است. یکی از محققان گفت: ” اگر شما دوربینی با کیفیت بالا داشته باشید پس مطمئنا دوربین شما مجهز به میکروفون نیز خواهد بود، بنابراین نیازی به نرمافزار لبخوانی نخواهید داشت”.

دو محقق معتقدند که این تکنولوژی میتواند به افراد دارای ناتوانی در شنوایی کمک کند، علیالخصوص در مکانهایی که کامپیوترها قادر به تشخیص جملات نیستند. مثلا، شخصی در مهمانی عینک مجهز به دوربین را بر روی چشمانش قرار داده و تصاویر فرد در حال سخنرانی برای یک سری افراد را به طور واضح ضبط میکند، سپس از طریق نرمافزار “LipNet” صحبتهای او رونویسی خواهد شد. آسائل میگوید: “هرجایی که نیاز به تشخیص صدا و دوربین باشد ما قادر به بهبود آن خواهیم بود”. او همچنین دیکته کردن کلمات بدون استفاده از صدا توسط “Siri” و “Google Assistant” را از دیگر قابلیتهای ممکن این نرمافزار در آینده عنوان کرد. احتمالا در آینده، افرادی که علاقهای به صحبت با کامپیوترشان ندارند، میتوانند دستگاهشان را مجبور کنند که دستوراتشان را لبخوانی کند. در ادامه میتوانید چند نمونه از نحوه کار این سیستم را ببینید.

منبع : آیتیایران