ویژگیهای جدید به چتجیپیتی اضافه شد / قابلیت پیشرفته صوتی برای همه کاربران پولی فعال میشود

OpenAI روز سهشنبه اعلام کرد که حالت پیشرفته صوتی (Advanced Voice Mode – AVM) را به مجموعه گستردهتری از کاربران پولی ChatGPT ارائه میکند. این قابلیت صوتی که ChatGPT را برای مکالمات طبیعیتر میسازد، در ابتدا برای کاربران سطوح Plus و Teams ارائه میشود. کاربران سطح Enterprise و Edu نیز از هفته آینده به این قابلیت دسترسی خواهند داشت.

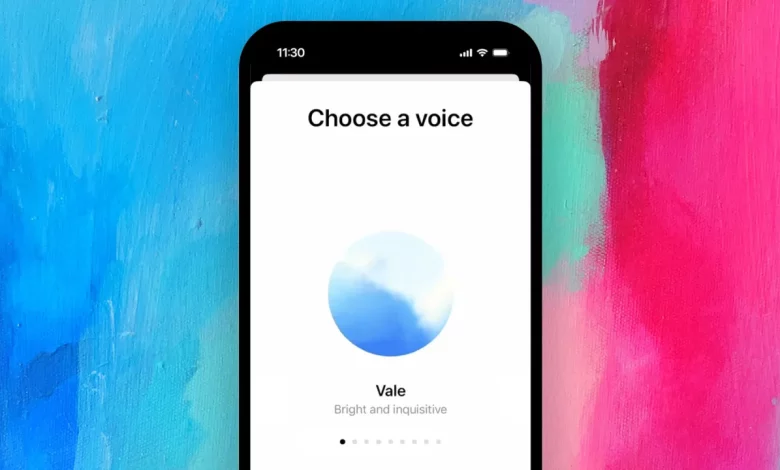

در این عرضه جدید، AVM با طراحی جدیدی همراه شده است. این ویژگی اکنون با یک کره آبی متحرک نمایش داده میشود، به جای نقاط سیاه متحرکی که OpenAI در معرفی فناوری خود در ماه مه ارائه کرده بود.

کاربران هنگامی که AVM برایشان در دسترس قرار بگیرد، یک پیام پاپآپ در کنار آیکون صدا در برنامه ChatGPT دریافت خواهند کرد.

حالت پیشرفته صوتی طی این هفته برای تمام کاربران Plus و Teams در برنامه ChatGPT عرضه خواهد شد.

در حین اینکه منتظر این قابلیت بودید، OpenAI ویژگیهایی مانند دستورالعملهای سفارشی (Custom Instructions)، حافظه (Memory)، پنج صدای جدید و بهبود لهجهها را اضافه کرده است. این ویژگی همچنین میتواند عبارات مختلفی مانند «ببخشید دیر کردم» را به بیش از ۵۰ زبان بیان کند.

ChatGPT پنج صدای جدید را معرفی کرده که کاربران میتوانند از آنها استفاده کنند: Arbor، Maple، Sol، Spruce و Vale. با اضافه شدن این صداها، تعداد کل صداهای ChatGPT به ۹ صدا افزایش یافته است (تقریباً به تعداد صدای Google Gemini Live). سایر صداها شامل Breeze، Juniper، Cove و Ember هستند. نام این صداها به نظر میرسد از طبیعت الهام گرفته شده باشند، شاید به این دلیل که هدف اصلی AVM ایجاد حس طبیعیتر در استفاده از ChatGPT است.

یکی از صداهایی که در این مجموعه نیست، Sky است؛ صدایی که OpenAI در بهروزرسانی بهاری خود معرفی کرد، اما به دلیل تهدید قانونی از طرف اسکارلت جوهانسون برداشته شد. بازیگری که در فیلم «Her» نقش یک سیستم هوش مصنوعی را ایفا کرد، ادعا کرد که صدای Sky بسیار شبیه صدای او است. OpenAI بلافاصله صدای Sky را برداشت و اعلام کرد که هرگز قصد نداشته صدای آن شبیه صدای جوهانسون باشد، اگرچه چند کارمند در توییتهایی به فیلم اشاره کرده بودند.

یکی دیگر از قابلیتهای غایب در این عرضه جدید، ویژگی ویدیو و اشتراکگذاری صفحه است که OpenAI در بهروزرسانی بهاری خود معرفی کرده بود. این ویژگی قرار بود به GPT-4 اجازه دهد به طور همزمان اطلاعات بصری و صوتی را پردازش کند. در دموی این قابلیت، یکی از کارکنان OpenAI نشان داد که چگونه میتوانید از ChatGPT سوالات ریاضی در زمان واقعی بپرسید یا کد موجود روی صفحه رایانه خود را تحلیل کنید. در حال حاضر، OpenAI زمان دقیقی برای عرضه این قابلیتهای چندوجهی ارائه نکرده است.

با این حال، OpenAI اعلام کرده که از زمان آزمایش محدود AVM، بهبودهایی را ایجاد کرده است. گفته میشود که قابلیت صوتی ChatGPT اکنون بهتر میتواند لهجهها را تشخیص دهد و مکالمات روانتر و سریعتر شدهاند. در آزمایشهایی که ما با AVM انجام دادیم، مشکلاتی گاه به گاه رخ میداد، اما شرکت ادعا میکند که اکنون این مشکلات بهبود یافتهاند.

OpenAI همچنین برخی از ویژگیهای شخصیسازی ChatGPT را به AVM گسترش داده است: دستورالعملهای سفارشی که به کاربران اجازه میدهد پاسخهای ChatGPT را بر اساس ترجیحات خود تنظیم کنند، و حافظه که به ChatGPT امکان میدهد تا مکالمات گذشته را برای مراجعات بعدی به خاطر بسپارد.

یک سخنگوی OpenAI اعلام کرد که AVM هنوز در چند منطقه از جمله اتحادیه اروپا، بریتانیا، سوئیس، ایسلند، نروژ و لیختناشتاین در دسترس نیست.