پلتفرم هوش مصنوعی ClearGPT ویژه سازمانها رونمایی شد

شرکت ClearML از پلتفرم هوش مصنوعی مولد خود ویژه سازمانها تحت عنوان ClearGPT رونمایی کرد.

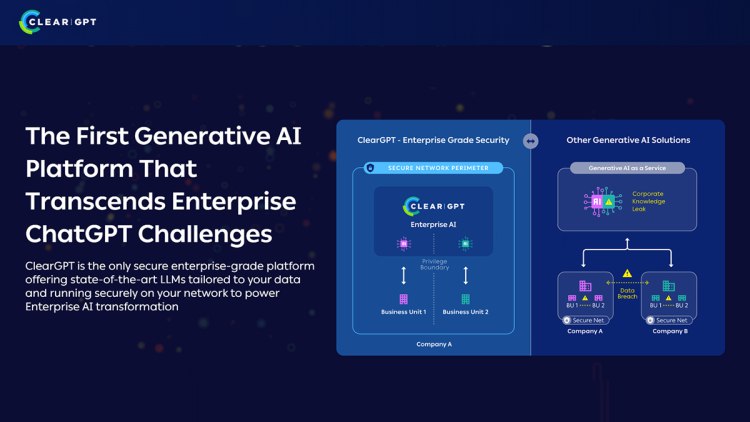

پلتفرمیکه با هدف توانمندسازی سازمانها برای استفاده ایمن و بهینه از پیشرفتهترین مدلهای زبان بزرگ (LLM) طراحی شده و به گفته این شرکت، وجه تمایز آن با دیگر پلتفرمها سفارشیسازی مدلهای زبان بزرگ برای همسو شدن با دادههای خاص شرکتها و عملکرد یکپارچه در شبکه است.

این ابزار به کسبوکارها این امکان را میدهد با بهرهگیری از قدرت فناوری مدلهای زبان بزرگ همانند ChatGTP و استفاده از هوش مصنوعی در جهت نوآوری، بهرهوری و کارایی، عملکرد خود را بهبود بخشند.

به گفته این شرکت، هدف ClearGPT کمک به شرکتها و سازمانهاست تا بتوانند توسعه محصولات داخلی و خارجی خود را با سرعت بیشتری دنبال کنند، از رقبا پیشی بگیرند و به خلق درآمدهای جدید کمک کند.

موزس گاتمن، مدیرعامل ClearML میگوید: پلتفرم جدید ما جایگزینی برای یک رابط چت LLM همانند ChatGPT برای شرکتها و سازمانهاست. درواقع، ClearGPT به شرکتها این اجازه را میدهد تا مدلهای هوش مصنوعی را مستقیما از دادههای سازمانی خود کنترل و ایجاد کنند. همچنین شرکتها میتوانند از ClearGPT برای استقرار مدل خود به عنوان یک API استفاده و در برنامههای داخلی خود تعبیه و ادغام کنند.

به گفته این شرکت، پلتفرم طراحیشده قادر است گردش کار شرکتها را به صورت رمزنگاریشده مدیریت کند به طوری که تمامیاطلاعات داخلی سازمانها از منابعی مانند گوگل درایو، شیرپوینت یا اسلک به طور ایمن گردآوری میشود.

به عبارتی دیکر، ClearGPT یک محیط سازمانی کاملا امن ایجاد میکند و به کسبوکارها اجازه میدهد تا از ظرفیتهای فناوری هوش مصنوعی بدون به خطر انداختن امنیت اطلاعات خود استفاده کنند.

همچنین این پلتفرم، تمامیفرآیند ساخت و بکارگیری مدل هوش مصنوعی را در دل شبکه امن سازمانی انجام میدهد. بدین معنی که دادهها به یک شرکت یا شخص ثالث منتقل نمیشود.

به بیانی دیگر، در این روش، شرکتها برخلاف سایر راهکارهای مولد هوش مصنوعی، مالکیت ۱۰۰ درصدی دادهها و هر هوش مصنوعی تولیدشده از آن هستند. این شرکت میگوید استفاده از APIهای عمومیبرای دسترسی به مدلهای هوش مصنوعی، موجب آسیبپذیری شرکتها در برابر نشتهای اطلاعاتی و نقض حریم خصوصی میشود اما ClearGPT با ارائه یک محیط امن در داخل شبکه سازمان، کنترل کامل اطلاعات و جلوگیری از نشت اطلاعات را تضمین میکند.

گاتمن توضیح میدهد که شرکتها میتوانند با استفاده از دادههای داخلی و ساخت مدلهای هوش مصنوعی و ارائه دادههای تازه برای آموزش مدلها، به قابلیتهای هوش مصنوعی پویا دست یابند. در این روش، میتوان مطمئن بود که مدلهای هوش مصنوعی به آخرین نسخه دادههای سازمانی دسترس دارند.